デジタル・インフラストラクチャが高度に複雑化し、生成AIやマイクロサービスが標準となった2026年現在、システムのパフォーマンスはもはや単なる技術的な一側面ではない。それは、ユーザー体験の質、ビジネスの収益性、さらには検索エンジンにおける可視性を決定づける最も重要な経営資産である。本レポートでは、パフォーマンス・チェックにおいて双璧をなす指標である「レイテンシ(Latency)」と「QPS(Queries Per Second)」の本質的な違いを解き明かし、最新の技術動向やビジネスへの影響を、海外の最新文献や実例を交えて詳細に解説する。

パフォーマンスの根幹を成す二大指標の定義と本質

システムのパフォーマンスを語る際、最も基本的でありながら混同されやすいのがレイテンシとスループット(QPS)の関係である。これらはシステムの異なる側面を測定するものであり、改善のためのアプローチも根本的に異なる。

レイテンシ:個別の体験を測る「時間の尺度」

レイテンシとは、一つのリクエストが送信されてから、その応答がクライアントに到達するまでにかかる「遅延時間」を指す 1。これは「クリックから反応までの隙間」と表現することもできる 3。レイテンシは主にミリ秒(ms)やマイクロ秒(μs)といった時間単位で測定され、その値が小さいほど、ユーザーにとって「速い」システムであると感じられる 4。

レイテンシは複数の要素の積み上げによって構成される。具体的には、データが物理的な距離を移動する「伝播遅延」、ルーターやスイッチがパケットを処理する「ネットワーク遅延」、サーバーがリクエストを処理する「処理遅延」、そしてデータが回線に送り出されるまでの「シリアル化遅延」などが含まれる 2。2026年時点での最新のネットワーク環境では、5Gスタンドアロン(SA)の普及により、モバイル環境でも7.2ms程度の超低レイテンシが実現されている地域もある 7。

QPS:システム全体の「容量と処理能力」

QPS(Queries Per Second)は、システムが1秒間に処理できるリクエストの総量を指し、スループットの代表的な測定単位である 1。これはシステムがどれだけの「仕事」をこなせるかというキャパシティ(容量)を示している。QPSが高いシステムは、同時に多数のユーザーがアクセスしても破綻することなく処理を継続できる能力を持つ。

| 指標 | 焦点 | 単位 | ユーザー体験への影響 |

| レイテンシ | 個別のリクエストの「速さ」 | 時間 (ms, μs) | 個人の操作感、満足度 |

| QPS (スループット) | システム全体の「処理量」 | リクエスト数/秒 | 混雑時の安定性、収容人数 |

これら二つの指標は、一見すると独立しているように見えるが、実際にはリソースを共有する中で密接に、そしてしばしば相反するように関連している。例えば、大量のリクエスト(高QPS)を一度に処理しようとすると、サーバーのリソースが飽和し、結果として個々のリクエストの待ち時間(レイテンシ)が増大するという現象が一般的である 1。

非エンジニアのための直感的なメタファー:ラーメン店と高速道路

技術的な概念を非エンジニアやビジネスリーダーに説明する際、物理的な事象に例えることは非常に有効である。ここでは、広く用いられる「飲食店」と「道路」の例えを用いて、レイテンシとQPSの関係を解明する。

ラーメン店におけるパフォーマンスの解釈

ある繁盛しているラーメン店を想像してほしい 9。

- レイテンシ: 一人の客が注文してから、目の前にラーメンが提供されるまでの時間である。厨房が非常に効率的であれば、注文から3分で提供される。これが「低レイテンシ」の状態である。

- QPS(スループット): 1時間(あるいは1秒間)に、店が何杯のラーメンを提供できたかである。店内に100席あり、常に満席で回転していれば、提供スピードが多少遅くても、店全体の処理量(QPS)は高くなる。

- 帯域幅(Bandwidth): 店の座席数や、同時に調理できるコンロの数である 4。

客(ユーザー)にとって重要なのは「自分のラーメンがいつ来るか(レイテンシ)」であり、店主(システム運用者)にとって重要なのは「今日何杯売れたか(QPS)」である。もし店主がQPSを最大化しようとして、厨房の能力を超える客を一度に入れてしまうと、一人あたりの提供時間(レイテンシ)は急激に悪化し、客は不満を感じて店を去ってしまうだろう 1。

高速道路における物理的限界

もう一つの有力な例えは「交通量」である 2。

- レイテンシ: 一台の車がA地点からB地点に移動するのにかかる時間。

- QPS(スループット): 道路の特定の地点を1秒間に通過する車の台数。

- 帯域幅(Bandwidth): 道路の車線数。車線が多ければ、一度に多くの車が走れる(理論上の最大容量)。

深夜の空いている高速道路では、車は制限速度いっぱいで走れるためレイテンシは最小になるが、通過する台数(QPS)は少ない。一方で、通勤ラッシュ時には道路の車線(帯域幅)が車で埋め尽くされ、通過台数(QPS)は最大に近づくが、渋滞が発生して一台あたりの移動時間(レイテンシ)は大幅に増大する。システム設計においても、この「渋滞が始まる直前の最適点」をいかに見つけるかがパフォーマンス・チェックの核心となる 1。

リトルの法則:パフォーマンスを支配する数学的原理

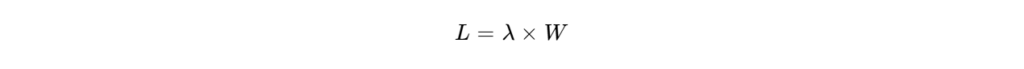

パフォーマンス・チェックにおいて、レイテンシとQPSの関係を科学的に裏付けるのが、待ち行列理論における「リトルの法則(Little’s Law)」である 10。この法則は、どのようなシステムにおいても定常状態であれば成立する極めて強力な定理である。

公式の定義と構成要素

リトルの法則は以下の数式で表される 10。

(平均滞留数): システムの中に存在するリクエストの平均数(仕掛品)。

(到着率/スループット): 単位時間あたりに到着するリクエスト数(QPS)。

(平均滞在時間): 一つのリクエストがシステム内に滞在する平均時間(レイテンシ)。

この法則の驚異的な点は、システム内部の具体的な構造や、リクエストの到着分布、処理時間の分布に依存せず、常に成立することである 11。

実務への応用:なぜ「キュー」が重要なのか

この法則を実務に当てはめると、システムの限界を予測できるようになる。例えば、あるサーバーが同時に10個のリクエスト()を処理できる能力を持っているとする。もし1秒間に100個のリクエスト(

QPS)が届く場合、レイテンシ(

)は数学的に

秒(100ms)となる 10。

しかし、もしQPSがさらに増加して200 QPS()になった場合、サーバーの同時処理能力(

)が10のままであれば、レイテンシは50msに短縮される必要がある。もし処理時間を短縮できなければ、入りきらないリクエストは「待ち行列(キュー)」に溜まることになる。キューに溜まったリクエストは、システム全体の滞留数(

)を増大させ、結果として個々のリクエストの待ち時間(

)を劇的に悪化させる 8。

パフォーマンス・チェックにおいて、QPSを上げながらレイテンシを一定に保つためには、並列処理能力()を増やす(サーバーの増設やマルチスレッド化)か、一件あたりの処理効率を高めて滞在時間(

)を短縮するしかないという明確な指針が、この法則から導き出される 12。

平均値の罠:パーセンタイル(P95/P99)による評価の重要性

伝統的なモニタリングでは「平均レイテンシ」が重視されてきた。しかし、現代の複雑な分散システムにおいて平均値はしばしば有害な誤解を招く。パフォーマンス・チェックにおいて最も意識すべきは「テール・レイテンシ(Tail Latency)」、すなわち分布の端にある遅いリクエストの挙動である 1。

パーセンタイル指標の役割

レイテンシの分布は通常、正規分布(ベルカーブ)ではなく、右側に長い裾を持つロングテール分布になる 16。

| 指標 | 説明 | 推奨される閾値 (例) |

| P50 (中央値) | 全リクエストの半分がこの時間内に完了。標準的な体験。 | < 100ms |

| P95 | 100回中95回はこの時間内に完了。大半のユーザーが経験する最悪値。 | < 300ms |

| P99 | 1%のユーザーが経験する極端な遅延。システムの不安定さの兆候。 | < 1,000ms |

| P99.9 | 1,000回に1回の遅延。マイクロサービスにおける致命的なボトルネック。 | < 2,000ms |

平均値は、ごく一部の非常に遅いリクエスト(外れ値)の影響を平滑化してしまう。しかし、ユーザーにとっては「平均が速いこと」よりも「自分がアクセスしたときに遅くないこと」が重要である 16。特に、何千回もサーバーと通信するような複雑なウェブページでは、どれか一つの通信がP99の遅延に捕まる確率は極めて高くなる 19。

正常系と異常系のレイテンシ分離

パフォーマンス・チェック時の重要な注意点として、成功したリクエストと失敗したリクエスト(エラー)のレイテンシを分けて測定することが挙げられる 21。 多くの場合、エラー(HTTP 500など)はサーバーが処理を途中で断念して即座に応答を返すため、正常な処理よりも「速く」終わることがある。もしシステムでエラーが多発している場合、これらの「速いエラー」が平均レイテンシを押し下げ、一見するとパフォーマンスが向上したかのような錯覚(ダッシュボード上の見かけの改善)を引き起こす危険がある 21。真のパフォーマンス改善を測るには、成功したリクエストのみのレイテンシを追跡しなければならない。

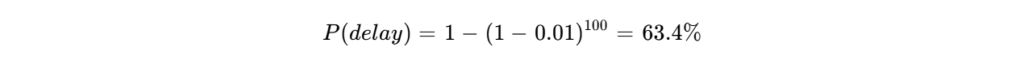

テール・アット・スケール:分散システムにおける遅延の増幅

Googleのジェフ・ディーンが提唱した「テール・アット・スケール(The Tail at Scale)」という概念は、マイクロサービスや分散システムを運用する上で避けて通れない課題である 19。現代のアプリケーションは、一つのユーザーリクエストを処理するために、背後で数十から数百の独立したサービス(マイクロサービス)を呼び出す。

確率論的な遅延の爆発

もし、一つのマイクロサービスが「1%の確率で1秒以上の遅延(P99)を発生させる」という特性を持っているとする。これ自体は一見許容できるように思える。しかし、一つのユーザーリクエストが100個のマイクロサービスを呼び出す場合、そのリクエスト全体が少なくとも一つの遅延したサービスに遭遇する確率は、以下のようになる 20。

つまり、個々のサービスは99%安定していても、システム全体で見れば、過半数のユーザーが「どこかが遅い」という体験を強いられることになる。これが、マイクロサービス・アーキテクチャにおいて個々のサービスのテール・レイテンシを極限まで抑え込まなければならない数学的な理由である 19。

増幅される「分散システム税」

マイクロサービス化によって、かつてはメモリ上のポインタジャンプ(ナノ秒単位)で済んでいた関数呼び出しが、ネットワーク経由のリモートプロシージャコール(RPC、ミリ秒単位)に置き換わる。この変化により、レイテンシは1,000倍から1,000,000倍に増大する 20。さらに、サービスメッシュ(IstioやLinkerdなど)の導入は、セキュリティや可観測性を提供する一方で、サイドカープロキシによる追加のホップ(遅延)を生じさせる 20。 調査によれば、同期的なマイクロサービスのホップが一つ増えるごとに、P99レイテンシは15〜25%増加する傾向がある 20。この「分散システム税」を最小化するために、gRPCのような高速なプロトコルや、非同期通信の採用が2026年の主流となっている 20。

ビジネス・インパクト:コンバージョンを左右する「ミリ秒の戦い」

パフォーマンスは単なる技術的指標ではなく、直接的に収益(Revenue)を規定するビジネス指標である 27。2025年から2026年にかけての複数の調査により、レイテンシの増大とコンバージョン率(CVR)の低下には、極めて明確な相関があることが実証されている。

レイテンシと売上の相関統計

大手eコマースや検索エンジンのデータに基づくと、わずかな遅延が以下のような劇的な損失をもたらすことが判明している 7。

| 遅延時間 (追加分) | コンバージョン率の低下 | 影響のメカニズム |

| +100ms | 1% 〜 2% の低下 | 心理的な「もたつき」が直感的な操作を阻害 |

| +500ms | 12% 〜 20% の低下 | ユーザーの集中力が途切れ、他サイトへの浮気を誘発 |

| +1.0秒 | 20% 〜 50% の低下 | サービスが「壊れている」と感じる閾値 |

| +3.0秒以上 | 直帰率が95%以上に達する | ほぼすべての新規ユーザーが離脱 |

ウォルマートの調査(2019年時点から継続)では、表示速度を1秒改善するごとにコンバージョンが2%向上することが示されており、現代のモバイルファースト環境ではこの感度はさらに高まっている 27。特に5Gが普及した2026年においては、ユーザーの期待値は「即時性」にシフトしており、2秒以上のロード時間は「不適切」と評価される 7。

2026年 eコマース・ベンチマーク

最新のeコマース市場における平均コンバージョン率と速度の関係は、業界によっても異なるが、概ね以下のような水準が「成功」の基準とされている 31。

- 世界平均 CVR: 2.5% 〜 3.0% 31

- 高パフォーマンス業界: フード&飲料(約6.11%)、美容・パーソナルケア(約4.55%) 31

- 速度の目標値: モバイルで2秒以下、デスクトップで1.5秒以下が「トップ10%」の基準 29。

日本市場に目を向けると、楽天やAmazon Japan、ヤフー(PayPay)といった巨大エコシステムが支配的であり、これらのプラットフォームと同等の「サクサク感」を提供できなければ、ユーザーを自社サイトに留めることは困難である 36。

SEOとユーザー体験:Core Web Vitalsの進化

検索エンジン最適化(SEO)の文脈においても、レイテンシは直接的なランキング要因である 29。Googleは「ページの表示速度」という抽象的な概念を、Core Web Vitals(CWV)という具体的な3つの指標に落とし込み、これを2026年現在も最重要視している。

主要なCWV指標とターゲット

- LCP (Largest Contentful Paint): ページ内で最も主要なコンテンツが表示されるまでの時間。2.5秒以内が「良好」とされる 29。

- INP (Interaction to Next Paint): 2024年に導入されたFIDに代わる新指標。ユーザーがクリックやタップをしてから、実際に画面が描き変わるまでの反応速度を測る。現代の「動的なウェブアプリ」におけるレイテンシの実態を映し出す 37。

- CLS (Cumulative Layout Shift): 読み込み中にコンテンツが動いてしまう視覚的な不安定さを測る。レイテンシが高い画像やスクリプトが後から読み込まれることで発生しやすい。

「エージェント型SEO」へのシフト

2026年の大きなトレンドとして、人間だけでなく「AIエージェント」が検索を代行する「エージェント型SEO(Agentic SEO)」が登場している 38。AI Overview(SGEの発展形)が検索結果の80%以上に表示される中、AIが情報を収集する際の「クロール効率」が重要視される。サーバーの応答レイテンシが低い(高速である)ことは、AIエージェントが効率的に情報をパースし、回答のソースとして引用するための必須条件となっている 38。

また、日本の検索市場はYahoo Japan(Googleエンジンのカスタマイズ)とGoogleの二強であり、特にモバイル比率が高い 41。日本語特有の文字エンコーディングや、複雑なフォントのレンダリング遅延は、CWVのスコアを悪化させる要因となりやすく、日本国内向けの最適化(UTF-8の徹底、Webフォントのサブセット化など)が不可欠である 41。

生成AI時代のパフォーマンス:TTFTとTPSの重要性

2025年から2026年にかけて、パフォーマンス・チェックの領域で最も注目を集めているのが、大規模言語モデル(LLM)の推論パフォーマンスである。従来の「ページ全体がいつ出るか」という考え方から、AIが「いつ喋り始めるか」という新しいレイテンシ指標が生まれた 17。

LLM固有のメトリクス

AIアプリケーションのパフォーマンスを評価する際は、以下の指標を意識する必要がある 43。

| 指標 | 名称 | 内容 | 体感への影響 |

| TTFT | Time To First Token | リクエスト送信から最初の1文字が出るまで。 | 「考えている時間」の長さ。ユーザーの不安に直結。 |

| TPOT | Time Per Output Token | 2文字目以降、1文字を生成する平均時間。 | 生成の「滑らかさ」。人間の読書速度(約50ms/文字)との対比。 |

| TPS | Tokens Per Second | 1秒間に生成されるトークン数(スループット)。 | システム全体の処理能力。コスト効率の指標。 |

| ITL | Inter-Token Latency | トークン間の正確なポーズ時間。 | 表示がガタつかないかどうかの指標。 |

LLM最適化のトレードオフ

AIモデルの提供において、QPSとレイテンシのトレードオフはさらに顕著になる 45。

- スループット重視: 多数のリクエストを一括して処理する(バッチング)ことで、GPUの利用効率を高めTPS(スループット)を向上させる。しかし、一括処理を待つ分、個々のユーザーのTTFT(レイテンシ)は悪化する 45。

- 低レイテンシ重視: リクエストを到着順に即座に処理する。TTFTは最小化されるが、GPUを占有するため同時にさばける人数(QPS)は減少する 45。

2026年の最新プラットフォーム(TensorZeroなど)では、Rustベースの超高速ゲートウェイを使用することで、10,000 QPSの高負荷下でもサブミリ秒のオーバーヘッドでLLMを制御する技術が実現されている 46。

サーバーレスとエッジ:2026年のインフラ主流

インフラ構成においても、レイテンシ削減のためのパラダイムシフトが起きている。その中心にあるのが、サーバーレス・アーキテクチャとエッジ・コンピューティングである 27。

サーバーレスの「コールドスタート」問題

AWS LambdaやGoogle Cloud Functionsに代表されるサーバーレスは、QPSに応じて無限にスケールできるという最大の利点を持つ 47。しかし、長期間アクセスがない後にリクエストが来た際、実行環境をゼロから立ち上げる「コールドスタート」が数秒のレイテンシを発生させる 47。 2026年現在の対策としては、以下の手法が一般的である:

- Provisioned Concurrency: 一定数のインスタンスを常に「温めて」おくことで、レイテンシを一定に保つ 47。

- ランタイムの軽量化: 重いJavaやPythonではなく、起動の速いNode.jsやRustを選択する 47。

エッジ・アクセラレーションのROI

データの発生場所の近くで処理を行うエッジ・コンピューティングは、物理的な距離による伝播遅延を解消する最強の手段である 27。Tencent Cloud EdgeOneやCloudflareなどのサービスを用いた実証データによれば、ページロード時間を3.8秒から0.9秒に削減(-76%)することで、コンバージョン率を50%向上させた事例も報告されている 27。 この投資対効果(ROI)は劇的で、月商1億円のビジネスであれば、エッジ導入による増収分だけでコストの数百倍から数千倍の利益を生む可能性がある 27。

オブザーバビリティ:2026年のパフォーマンス・チェック手法

もはや「監視(Monitoring)」だけでは不十分であり、システムの内部状態を深く理解する「オブザーバビリティ(Observability:可観測性)」がパフォーマンス・チェックの新たな主流となっている 49。

OpenTelemetryの標準化

2026年には、OpenTelemetry(OTel)がパフォーマンス計測のデファクトスタンダードとして確立された 50。ベンダーロックインを避けつつ、異なるクラウドサービスや言語を跨いだ「分散トレーシング」が可能になっている。 これにより、特定のユーザーリクエストが「どのマイクロサービスの、どのデータベースクエリで、何ミリ秒詰まったか」を、一つの画面で瞬時に特定できる。これはP99のテール・レイテンシの原因を調査する上で、必須のツールである 24。

AIによる自律型モニタリング

2026年の最新トレンドとして、AIが単なる「補助(副操縦士)」から、自らパフォーマンスの問題を発見し対処する「コラボレーター」へと進化している 50。

- 異常検知の自動化: 従来の静的な閾値(例:レイテンシが500msを超えたらアラート)ではなく、AIが過去のトレンドや季節性を学習し、「通常とは異なる微細な変化」を検知する 50。

- 自律型エージェント: 飽和度(Saturation)が高まった際に、AIが自動的にプロビジョニング済みのコンカレンシーを増やしたり、トラフィックを迂回させたりする運用も始まりつつある 50。

パフォーマンス・チェックの実践的ガイドライン

最後に、明日からの実務で意識すべきパフォーマンス・チェックの要点を、エンジニアと非エンジニアの両方の視点から整理する。

エンジニアが意識すべき「4つの黄金シグナル」

GoogleのSRE原則に基づいた「黄金のシグナル」は、システムの健全性を測る上での聖典である 5。

- Latency (レイテンシ): 成功リクエストと失敗リクエストを分けて測定し、P99を最重視する 5。

- Traffic (トラフィック): 現時点のQPSを把握し、負荷の傾向を分析する 5。

- Errors (エラー): 失敗したリクエストの割合を監視する。エラー自体がシステム負荷を下げている可能性も考慮する 5。

- Saturation (飽和度): 最も制約の厳しいリソース(メモリ、I/Oなど)が100%にどれだけ近いかを測る。これが高いとレイテンシが爆発的に増大する 5。

ビジネスリーダーが意識すべきチェックリスト

非エンジニアのステークホルダーは、以下の質問を通じてシステムの「ビジネス上の健康状態」を確認できる。

- 「平均値だけでなく、最悪1%(P99)のユーザーが何秒待たされているか?」 16

- 「QPSが今の2倍に跳ね上がったとき、システムはどこで『崖』を迎えるか?」 1

- 「最新のINP(反応速度)スコアは競合他社と比較してどうか?」 37

- 「ページスピードを0.1秒改善することで、どれだけの追加収益が見込めるか?」 27

日本市場特有の「おもてなし」としてのパフォーマンス

日本においてパフォーマンス・チェックを行う際は、日本のユーザーの「品質に対する期待値の高さ」を忘れてはならない 42。海外では許容されるようなわずかなレイテンシや、読み込み中の画面のガタつきは、日本のユーザーには「不信感」として映る。 特に、日本のモバイルユーザーは「電車内での移動中」など、電波環境が目まぐるしく変わる中で高いパフォーマンスを期待している 6。2026年の日本においては、単に「動く」だけでなく、どのような環境下でも「絹のように滑らか(Silk-smooth)」に動作することが、最大の差別化要因となるのである。

結論

パフォーマンス・チェックにおけるレイテンシとQPSは、単なる数字の羅列ではない。レイテンシはユーザー一人ひとりへの「敬意」の表れであり、QPSはビジネスがどこまで成長できるかという「野心」の限界を示している。

リトルの法則が示す通り、システムのキャパシティと個別の体験は密接にリンクしており、どちらか一方を軽視することは、ビジネスの崩壊を招きかねない。特に、生成AIの台頭やマイクロサービスの深化が進む2026年においては、テール・レイテンシ(P99)の管理こそがエンジニアリングの最前線となっている。

本レポートが示したように、100msの改善は1%の売上増を生む。この「ミリ秒の経済学」を深く理解し、OpenTelemetryのような最新の観測技術や、エッジ・アーキテクチャを活用して継続的な改善を行うこと。それこそが、2026年以降の過酷なデジタル市場で生き残り、勝利するための唯一の道である。パフォーマンスは、もはやコストセンターではなく、ビジネス価値を直接生み出す利益センターなのである。

引用文献

- How should one interpret latency vs. throughput trade-offs in benchmarks (e.g., a system might achieve low latency at low QPS, but latency rises under higher QPS)? – Milvus, 4月 13, 2026にアクセス、 https://milvus.io/ai-quick-reference/how-should-one-interpret-latency-vs-throughput-tradeoffs-in-benchmarks-eg-a-system-might-achieve-low-latency-at-low-qps-but-latency-rises-under-higher-qps

- Throughput vs Latency – Difference Between Computer Network Performances – AWS, 4月 13, 2026にアクセス、 https://aws.amazon.com/compare/the-difference-between-throughput-and-latency/

- Latency vs Throughput: Why They Get Mixed Up and Why That Matters – Cloudy Musings, 4月 13, 2026にアクセス、 https://www.shankuehn.io/post/latency-vs-throughput-why-they-get-mixed-up-and-why-that-matters

- Latency vs Throughput: Deep Dive into System Performance Trade‑Offs | by CoVaib DeepLearn | Medium, 4月 13, 2026にアクセス、 https://medium.com/@shivanimutke2501/%EF%B8%8F-latency-vs-throughput-deep-dive-into-system-performance-trade-offs-adcd5860dc56

- Mastering the Four Golden Signals of SRE: Throughput, Latency, Error Rate, and Saturation | by Proyash Paban Sarma Borah | Medium, 4月 13, 2026にアクセス、 https://medium.com/@Spritan/mastering-the-four-golden-signals-of-sre-throughput-latency-error-rate-and-saturation-40575992a562

- Latency vs Throughput vs Bandwidth: What They Mean and How to Monitor Them | Kentik, 4月 13, 2026にアクセス、 https://www.kentik.com/kentipedia/latency-vs-throughput-vs-bandwidth/

- TOP 20 MOBILE SITE LOAD SPEED STATISTICS 2026 REVEAL HOW SECONDS DESTROY CONVERSIONS – Amra & Elma, 4月 13, 2026にアクセス、 https://www.amraandelma.com/mobile-site-load-speed-statistics/

- Optimize Model Serving endpoints for production | Databricks on AWS, 4月 13, 2026にアクセス、 https://docs.databricks.com/aws/en/machine-learning/model-serving/production-optimization

- 現場のムダな滞留が見えてくる? 物流と「リトルの法則」 – SGフィルダー, 4月 13, 2026にアクセス、 https://www.sg-fielder.co.jp/business/butsuryu/productivity/%E7%8F%BE%E5%A0%B4%E3%81%AE%E3%83%A0%E3%83%80%E3%81%AA%E6%BB%9E%E7%95%99%E3%81%8C%E8%A6%8B%E3%81%88%E3%81%A6%E3%81%8F%E3%82%8B%EF%BC%9F-%E7%89%A9%E6%B5%81%E3%81%A8%E3%80%8C%E3%83%AA%E3%83%88%E3%83%AB/

- Little’s law – Wikipedia, 4月 13, 2026にアクセス、 https://en.wikipedia.org/wiki/Little%27s_law

- Little’s Law – Knowledge and References – Taylor & Francis, 4月 13, 2026にアクセス、 https://taylorandfrancis.com/knowledge/Engineering_and_technology/Industrial_engineering_%26_manufacturing/Little%27s_Law/

- Using Little’s Law to Measure System Performance | Kevin Sookocheff, 4月 13, 2026にアクセス、 https://sookocheff.com/post/modeling/littles-law/

- Mastering Performance Engineering- A Guide to Workload Modelling and Little’s Law, 4月 13, 2026にアクセス、 https://community.ibm.com/community/user/blogs/gaurav-dangaich/2024/07/03/workload-modelling-and-littles-law

- Theory Behind Performance – Dynatrace, 4月 13, 2026にアクセス、 https://www.dynatrace.com/resources/ebooks/javabook/theory-behind-performance/

- Defining slo: service level objective meaning – Google SRE, 4月 13, 2026にアクセス、 https://sre.google/sre-book/service-level-objectives/

- 7 Infrastructure Metrics Every DevOps Engineer Should Be Tracking in 2025 – Firefly AI, 4月 13, 2026にアクセス、 https://www.firefly.ai/academy/7-infrastructure-metrics-every-devops-engineer-should-be-tracking-in-2025

- Key metrics for LLM inference – BentoML, 4月 13, 2026にアクセス、 https://bentoml.com/llm/inference-optimization/llm-inference-metrics

- Outline of Google’s SRE book Chapter 4: Service Level Objectives – GitHub Gist, 4月 13, 2026にアクセス、 https://gist.github.com/jonbrouse/921658823a094eb7888d45b676bfb173

- The tail at scale | Request PDF – ResearchGate, 4月 13, 2026にアクセス、 https://www.researchgate.net/publication/262159720_The_tail_at_scale

- Quantifying the distributed system tax! A performance analysis of microservice architectures., 4月 13, 2026にアクセス、 https://djimit.nl/quantifying-the-distributed-system-tax-a-performance-analysis-of-microservice-architectures/

- SRE Metrics: Core SRE Components, the Four Golden Signals & SRE KPIs | Splunk, 4月 13, 2026にアクセス、 https://www.splunk.com/en_us/blog/learn/sre-metrics-four-golden-signals-of-monitoring.html

- SREの中核を担うモニタリングの必要性とその戦略について理解 …, 4月 13, 2026にアクセス、 https://sreake.com/blog/sre-monitoring-strategy/

- SRE の原則を使用し、Cloud Monitoring ダッシュボードでパイプラインをモニタリングする, 4月 13, 2026にアクセス、 https://cloud.google.com/blog/ja/products/management-tools/the-right-metrics-to-monitor-cloud-data-pipelines

- Leveraging Deep Learning to Improve Performance Predictability in Cloud Microservices with Seer – Computer Systems Laboratory, 4月 13, 2026にアクセス、 https://www.csl.cornell.edu/~delimitrou/papers/2019.sigops.seer.pdf

- An Open-Source Benchmark Suite for Microservices and Their Hardware-Software Implications for Cloud & Edge Systems, 4月 13, 2026にアクセス、 https://www.csl.cornell.edu/~delimitrou/papers/2019.asplos.microservices.pdf

- Low-Latency File-Based Ordered Message Delivery at Scale – arXiv, 4月 13, 2026にアクセス、 https://arxiv.org/pdf/2512.04096

- The Real Impact of Latency on Conversion Rates: Why Every 100ms Matters for Your Business – Tencent Cloud, 4月 13, 2026にアクセス、 https://www.tencentcloud.com/techpedia/143892

- Latency vs quality tradeoffs: Optimization strategies – Statsig, 4月 13, 2026にアクセス、 https://www.statsig.com/perspectives/latency-quality-tradeoffs

- Website Speed and Page Load Time Statistics For 2026, 4月 13, 2026にアクセス、 https://www.wearetenet.com/blog/website-speed-page-load-time-statistics

- How fast should a website load in 2026? – Hobo, 4月 13, 2026にアクセス、 https://www.hobo-web.co.uk/your-website-design-should-load-in-4-seconds/

- Average Ecommerce Conversion Rate: Industry Data for 2026 – Red Stag Fulfillment, 4月 13, 2026にアクセス、 https://redstagfulfillment.com/average-conversion-rate-for-ecommerce/

- Ecommerce Conversion Rate Benchmarks in 2025-26 – Nector.io, 4月 13, 2026にアクセス、 https://www.nector.io/blog/ecommerce-conversion-rate-benchmarks

- Ecommerce Conversion Rate By Industry In 2025 – Replo Blog, 4月 13, 2026にアクセス、 https://www.replo.app/blog/ecommerce-conversion-rate-by-industry

- E-commerce Conversion Rate Statistics 2026: Latest Benchmarks – SQ Magazine, 4月 13, 2026にアクセス、 https://sqmagazine.co.uk/e-commerce-conversion-rate-statistics/

- The 2025 SEO Benchmarks Report: Average Site Speed, CTR, and Backlink Growth, 4月 13, 2026にアクセス、 https://seomator.com/blog/seo-benchmarks-report

- Japan E-commerce Market Size & Share Outlook to 2031 – Mordor Intelligence, 4月 13, 2026にアクセス、 https://www.mordorintelligence.com/industry-reports/japan-ecommerce-market

- Mobile-First Marketing in Japan (2026): A Playbook for Foreign Brands – Krows Digital, 4月 13, 2026にアクセス、 https://krows-digital.com/mobile-first-marketing-japan-2026/

- 2026 SEO Trends and What It Mean for Your Business, 4月 13, 2026にアクセス、 https://circlesstudio.com/blog/seo-trends/

- 【2026年最新版】SEOとは?SEO対策の基本や上位表示に必要な考え方をわかりやすく解説, 4月 13, 2026にアクセス、 https://leosophia.co.jp/marketing/what-is-seo/

- The 2025 Cloudflare Radar Year in Review: The rise of AI, post-quantum, and record-breaking DDoS attacks, 4月 13, 2026にアクセス、 https://blog.cloudflare.com/radar-2025-year-in-review/

- SEO in Japan: Complete Guide to Ranking on Google Japan & Yahoo Japan | Hashmeta, 4月 13, 2026にアクセス、 https://hashmeta.com/blog/seo-in-japan-complete-guide-to-ranking-on-google-japan-yahoo-japan/

- Guide to Japan SEO, and How It Differs from Other Markets, 4月 13, 2026にアクセス、 https://www.zodigital.jp/blog/guide-to-japan-seo/

- Understanding LLM Performance, 4月 13, 2026にアクセス、 https://cseweb.ucsd.edu/~yiying/cse291a-fall25/reading/llm-perf.pdf

- Understand LLM latency and throughput metrics – Anyscale Docs, 4月 13, 2026にアクセス、 https://docs.anyscale.com/llm/serving/benchmarking/metrics

- TTFT vs Throughput: Which Metric Impacts Users More? – Clarifai, 4月 13, 2026にアクセス、 https://www.clarifai.com/blog/ttft-vs-throughput

- Benchmarks – TensorZero Docs, 4月 13, 2026にアクセス、 https://www.tensorzero.com/docs/gateway/benchmarks

- Serverless Architectures: Benefits, Challenges, and Best Practices for 2025, 4月 13, 2026にアクセス、 https://kitemetric.com/blogs/serverless-architectures-benefits-challenges-and-best-practices-for-2025

- Serverless Architecture for Legacy Applications: Is It Viable in 2025? – ModLogix, 4月 13, 2026にアクセス、 https://modlogix.com/blog/serverless-architecture-for-legacy-applications-is-it-viable-in-2025/

- 2026年のオブザーバビリティ展望:コストとイノベーションのバランス | Elastic, 4月 13, 2026にアクセス、 https://www.elastic.co/jp/resources/observability/report/landscape-observability-report

- 2026年のオブザーバビリティトレンド予測 | Grafana Labs, 4月 13, 2026にアクセス、 https://grafana.com/ja/blog/2026-observability-trends-predictions-from-grafana-labs-unified-intelligent-and-open/?pg=blog&plcmt=featured

- OpenTelemetryとは?基本やメリット、課題をわかりやすく解説 – New Relic, 4月 13, 2026にアクセス、 https://newrelic.com/jp/blog/observability/opentelemetry-guide

- SRE導入「4大シグナル」 #SRE – Qiita, 4月 13, 2026にアクセス、 https://qiita.com/harukin721/items/5c52767bac5b97bc9d74